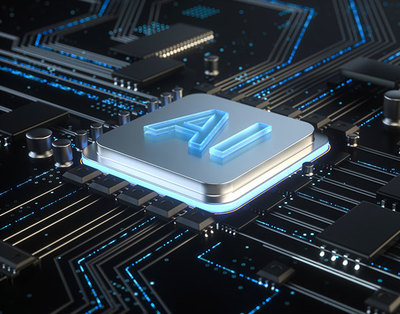

AI加速卡是什么?一文拆解 人工智能背后的“速度密碼”!

在人工智能技術(shù)迅猛發(fā)展的今天,無論是語音識(shí)別、圖像處理還是自動(dòng)駕駛,背后都離不開強(qiáng)大的計(jì)算能力支撐。而傳統(tǒng)的中央處理器(CPU)在處理這些海量、并行且高度復(fù)雜的AI任務(wù)時(shí),往往顯得力不從心。這時(shí),一種名為“AI加速卡”的專用硬件便應(yīng)運(yùn)而生,成為了驅(qū)動(dòng)人工智能時(shí)代前進(jìn)的關(guān)鍵引擎。本文將深入解析AI加速卡的原理、作用及其與計(jì)算機(jī)軟件開發(fā)的緊密聯(lián)系。

一、AI加速卡的定義與核心原理

AI加速卡,通常指的是為加速人工智能計(jì)算任務(wù)而專門設(shè)計(jì)的硬件加速器,最常見的形式是圖形處理器(GPU),也包括專門為AI設(shè)計(jì)的張量處理單元(TPU)、神經(jīng)網(wǎng)絡(luò)處理器(NPU)等。其核心原理在于其架構(gòu)與CPU的“通用”性不同,它采用了“專用”或“大規(guī)模并行”的設(shè)計(jì)思路。

- 并行計(jì)算能力:AI計(jì)算,尤其是深度學(xué)習(xí)中的矩陣乘法和卷積運(yùn)算,天然具有高度的并行性。一顆CPU僅有少數(shù)幾個(gè)高性能核心,擅長(zhǎng)處理復(fù)雜的串行邏輯。而一顆AI加速卡(如高端GPU)則集成了數(shù)千乃至上萬個(gè)更簡(jiǎn)單、更節(jié)能的核心,能夠同時(shí)處理海量數(shù)據(jù),在AI訓(xùn)練和推理任務(wù)上實(shí)現(xiàn)數(shù)十倍甚至數(shù)百倍的性能提升。

- 高帶寬內(nèi)存:AI模型參數(shù)和訓(xùn)練數(shù)據(jù)量極其龐大。AI加速卡通常配備專用的高帶寬內(nèi)存(如HBM),確保數(shù)據(jù)能夠以極高的速度喂給計(jì)算核心,避免因數(shù)據(jù)等待(“內(nèi)存墻”)造成的性能瓶頸。

- 專用指令集與硬件單元:現(xiàn)代的AI加速卡內(nèi)置了針對(duì)張量運(yùn)算的專用硬件單元(如NVIDIA的Tensor Core),能夠以極高的效率和精度執(zhí)行混合精度計(jì)算,進(jìn)一步釋放性能潛力。

二、AI加速卡在AI工作流中的關(guān)鍵作用

AI加速卡主要賦能于人工智能的兩個(gè)核心階段:訓(xùn)練(Training) 和 推理(Inference)。

- 模型訓(xùn)練:這是最耗計(jì)算資源的階段。研究人員需要利用海量數(shù)據(jù),通過復(fù)雜的算法反復(fù)調(diào)整神經(jīng)網(wǎng)絡(luò)中數(shù)以億計(jì)的參數(shù)。這個(gè)過程需要巨量的浮點(diǎn)計(jì)算。AI加速卡的并行計(jì)算能力能夠?qū)⒃拘枰獢?shù)周甚至數(shù)月的訓(xùn)練時(shí)間縮短到幾天或幾小時(shí),極大地加速了AI模型的迭代和創(chuàng)新周期。

- 模型推理:訓(xùn)練好的模型投入實(shí)際應(yīng)用,對(duì)新的輸入數(shù)據(jù)做出預(yù)測(cè)或決策,即為推理。雖然單次推理的計(jì)算量遠(yuǎn)小于訓(xùn)練,但在實(shí)際場(chǎng)景中(如每天處理數(shù)億次的圖片識(shí)別請(qǐng)求),需要高并發(fā)、低延遲地處理。專用的推理加速卡(或GPU的推理模式)能夠以高能效比提供強(qiáng)大的實(shí)時(shí)計(jì)算能力,確保AI應(yīng)用流暢運(yùn)行。

三、AI加速卡與計(jì)算機(jī)軟件開發(fā)的深度協(xié)同

AI加速卡的強(qiáng)大硬件能力,必須通過軟件棧才能被開發(fā)者便捷、高效地調(diào)用。這正是計(jì)算機(jī)軟件開發(fā)的核心用武之地,兩者共同構(gòu)成了AI時(shí)代的“速度密碼”。

- 驅(qū)動(dòng)與底層庫:硬件廠商會(huì)提供核心驅(qū)動(dòng)程序(Driver)和底層計(jì)算庫(如NVIDIA的CUDA、AMD的ROCm、Intel的oneAPI)。這些軟件層將加速卡的硬件功能抽象成編程接口,是硬件能力暴露給上層軟件的基礎(chǔ)。

- 高級(jí)框架與編譯器:這是AI開發(fā)者的主要戰(zhàn)場(chǎng)。主流的深度學(xué)習(xí)框架,如TensorFlow、PyTorch、PaddlePaddle等,其底層計(jì)算操作都通過調(diào)用CUDA等庫,被映射到AI加速卡上執(zhí)行。開發(fā)者使用高級(jí)Python等語言編寫模型代碼,框架和編譯器則負(fù)責(zé)將其高效地編譯、優(yōu)化并調(diào)度到加速卡硬件上運(yùn)行。軟件開發(fā)者的任務(wù),就是利用這些工具構(gòu)建和優(yōu)化AI模型。

- 模型優(yōu)化與部署工具:為了進(jìn)一步提升推理效率,軟件開發(fā)還涉及模型優(yōu)化技術(shù),如量化(降低數(shù)值精度)、剪枝(移除冗余參數(shù))、知識(shí)蒸餾等,并利用TensorRT、OpenVINO等部署工具包,將優(yōu)化后的模型高效部署到各類AI加速卡甚至邊緣設(shè)備上。

- 生態(tài)與云服務(wù):成熟的軟件開發(fā)生態(tài)至關(guān)重要。云服務(wù)商(如AWS、Azure、阿里云)提供集成了各種AI加速卡的虛擬機(jī)實(shí)例和容器服務(wù),使開發(fā)者無需管理物理硬件,即可通過API和軟件開發(fā)工具快速獲取強(qiáng)大的AI算力,降低了AI應(yīng)用開發(fā)的門檻。

四、展望與挑戰(zhàn)

AI加速卡將繼續(xù)朝著更高性能、更高能效、更專業(yè)化的方向發(fā)展。軟硬件協(xié)同設(shè)計(jì)(Co-Design)將更加深入,新的編程模型、編譯技術(shù)將持續(xù)涌現(xiàn),以更充分地挖掘硬件潛力。對(duì)計(jì)算機(jī)軟件開發(fā)而言,挑戰(zhàn)在于如何更好地管理異構(gòu)計(jì)算資源、設(shè)計(jì)更優(yōu)的并行算法、以及構(gòu)建更統(tǒng)一高效的軟件棧,讓開發(fā)者能更專注于AI算法和應(yīng)用創(chuàng)新本身,而無需過度糾纏于底層硬件細(xì)節(jié)。

###

AI加速卡并非簡(jiǎn)單的“硬件升級(jí)”,它是為AI計(jì)算任務(wù)量身定制的“動(dòng)力心臟”。而計(jì)算機(jī)軟件開發(fā)則是駕馭這顆心臟的“神經(jīng)系統(tǒng)”與“操作手冊(cè)”。兩者深度融合,共同破解了人工智能的“速度密碼”,使得從前看似科幻的AI應(yīng)用得以走進(jìn)現(xiàn)實(shí),持續(xù)推動(dòng)著整個(gè)數(shù)字世界的智能化變革。對(duì)于開發(fā)者而言,理解AI加速卡的原理及其軟件生態(tài),已成為構(gòu)建下一代智能應(yīng)用不可或缺的核心技能。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://www.pinhun.net/product/52.html

更新時(shí)間:2026-05-12 12:38:27